Многие организации рассматривают большие данные (Big Data) не только как модное слово, но и как интеллектуальную систему для улучшения бизнеса и получения соответствующей информации и идей. Большие данные - это термин, который относится к управлению огромным объемом сложных необработанных данных из различных источников, таких как базы данных, социальные медиа, изображения, сенсорное оборудование, файлы журналов регистрации событий, мнения людей и т. д. Эти данные могут быть структурированными, полуструктурированными или неструктурированными. Поэтому для обработки таких данных, которая в условиях традиционных процедур обработки представляла бы собой сложный и трудоемкий процесс, используются специальные инструменты больших данных.

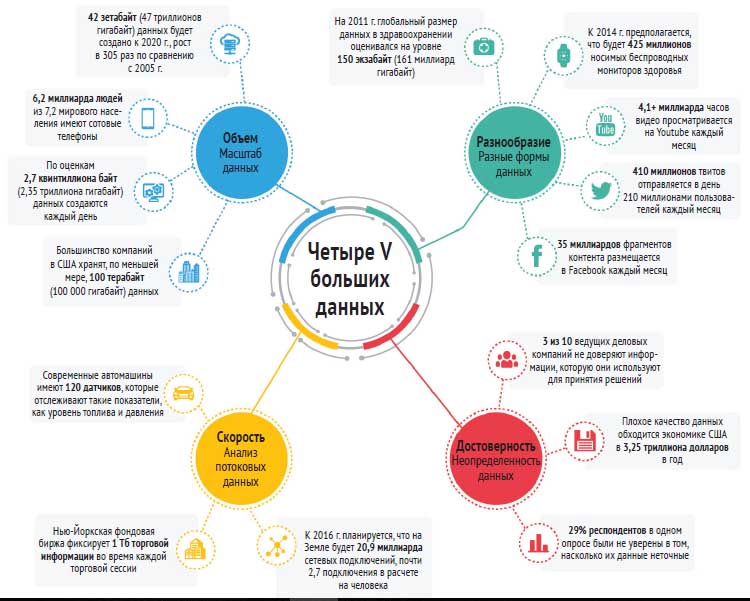

Жизненный цикл больших данных может быть сегментирован на объем, разнообразие, скорость и достоверность - обычно известные как ЧЕТЫРЕ V (Volume, Variety, Velocity и Veracity) БОЛЬШИХ ДАННЫХ. Давайте кратко их рассмотрим, а затем перейдем к четырем фазам жизненного цикла больших данных, то есть сбору, хранению, анализу и управлению данными.

Ниже показано несколько реальных сценариев, которые дают нам гораздо лучшее понимание четырех V и определения больших данных:

Объем

Объем подразумевает огромное количество данных, генерируемых и хранимых каждую секунду. Счет размера данных на предприятиях ведется уже не в терабайтах - он наращивается в зеттабайтах или бронтобайтах. Новые инструменты для работы с большими данными в настоящее время, как правило, используют распределенные системы, которые иногда могут быть диверсифицированы по всему миру.

Ожидается, что объем данных, полученных по всему миру к 2008 году, будет к 2020 году генерироваться всего за минуту.

Разнообразие

Разнообразие относится к нескольким типам и характеру данных, таких как потоки нажатий на веб-страницах, текст, датчики, изображения, голос, видео, файлы журналов регистрации событий, беседы в социальных сетях и многое другое. Это помогает людям, которые тщательно их изучают, эффективно их использовать для углубленного понимания.

70% данных в мире не структурированы, в частности текст, изображения, голос и т. д. Однако ранее структурированные данные были популярны из-за их доступности для анализа, поскольку они могут храниться в файлах, базах данных или поддаются традиционным процедурам хранения данных.

Скорость

Скорость подразумевает скорость генерирования, усвоения и обработки данных для удовлетворения потребностей и решения задач, которые возникают на пути эволюции и расширения.

Каналы связи нового поколения, такие как социальные сети, электронные письма и мобильные телефоны, прибавили скорости данным в больших данных. Процесс ежедневного отслеживания около 1 Тб информации о торговых событиях для выявления мошенничества чувствителен ко времени, когда иногда каждая минута имеет важное значение для предотвращения мошенничества. Просто представьте разговоры в социальных сетях, которые в считанные секунды могут становиться вирусными; на таких платформах анализ помогает нам выявлять тенденции.

Правдивость

Под достоверностью понимается несогласованность данных, которую можно обнаружить; она может повлиять на эффективное управление и обработку данных. Управление такими данными и придание им ценности - вот где могут помочь большие данные.

Когда мы говорим о больших данных, качество и точность остаются главной задачей. Разве не ради этого все крутится? Количество Twitter-каналов является подходящим вариантом применения, где изобилуют хештеги, опечатки, неофициальный текст и аббревиатуры; вместе с тем мы ежедневно сталкиваемся со сценариями, где большие данные отлично справляются со своей работой в серверной части и позволяют нам работать с таким типом данных.

Фазы жизненного цикла больших данных

Эффективное использование больших данных с экспоненциальным ростом в типах и объемах данных имеет огромный потенциал для преобразования экономической, деловой и маркетинговой информации и наращивания клиентской базы. Большие данные стали ключевой мантрой успеха для текущих конкурентных рынков, для существующих компаний и фактором, меняющим правила игры в конкурентной борьбе для новых компаний. Все это может оказаться истиной, только если задействуется ЦЕННОСТЬ ДАННЫХ. Давайте посмотрим на следующий ниже рисунок:

Как показано на рисунке, жизненный цикл больших данных можно разделить на четыре этапа. Рассмотрим их подробнее.

Сбор

Этот раздел является ключевым в жизненном цикле больших данных. Он определяет, какой тип данных фиксируется в источнике. В качестве примеров можно привести сбор журналов регистрации событий с сервера, извлечение профилей пользователей, автоматический обзор организаций для анализа мнений и сведений о заказах. Примеры, которые мы упомянули, могут включать в себя работу с локальным языком, текстом, неструктурированными данными и изображения - ми, в которых мы будем заинтересованы по мере продвижения вперед в жизненном цикле больших данных.

С повышением уровня автоматизации потоков коллекций данных меняются и организации, которые классически тратят много усилий на сбор структуриро - ванных данных для анализа и оценки ключевых точек успеха бизнеса. Зрелые организации теперь используют данные, в обычном случае игнорируемые из-за их размера или формата, которые в терминологии больших данных часто называются неструктурированными данными. Эти организации всегда стараются использовать максимальный объем информации, будь то структурированная или неструктурированная, так как для них данные представляют ценность как таковую.

Данные можно передать в платформу больших данных, такую как HDFS (Hadoop Distributed File System), и их там консолидировать. После того как данные обработаны с помощью таких инструментов, как Apache Spark, их можно загрузить обратно в базу данных MySQL, которая поможет заполнить соответствующими данными, чтобы показать, из каких составляющих MySQL состоит.

С ростом объемов данных и увеличением скорости теперь Oracle имеет интерфейс NoSQL, предназначенный для подсистем хранения данных InnoDB и MySQL Cluster. Подсистема MySQL Cluster дополнительно полностью обходит слой SQL. Без синтаксического анализа и оптимизации SQL данные в формате ключ- значение могут вставляться прямо в таблицы MySQL в девять раз быстрее.

Хранение

В этом разделе мы обсудим хранение данных, собранных из различных источников. Рассмотрим пример автоматических обзоров организаций для анализа мнений, где каждый обзор собирает данные с разных сайтов и по каждому отображаются уникальные данные.

Традиционно данные обрабатывались с помощью процедуры ETL (извлечение, трансформация и загрузка), которая использовалась для сбора данных из различных источников, их изменения в соответствии с требованиями и загрузки в хранилище для дальнейшей обработки или отображения. Для подобных сценариев очень часто использовались такие инструменты, как электронные таблицы, реляционные СУБД, инструменты бизнес-аналитики и т. д., а иногда и вручную.

Наиболее распространенным хранилищем, используемым в платформе больших данных, является HDFS. HDFS также предоставляет в распоряжение язык запросов HQL (Hive Query Language), который помогает выполнять многие аналитические задачи, которые традиционно выполняются инструментами биз- нес-аналитики. Можно рассмотреть несколько других вариантов хранения - это Apache Spark, Redis и MongoDB. Каждый вариант хранения имеет свой собственный способ работы в серверной части; однако большинство поставщиков хранения предоставляет прикладные программные интерфейсы SQL, которые могут использоваться для дальнейшего анализа данных.

Также может возникнуть ситуация, когда нам нужно собирать и демонстрировать данные в реальном времени, которая практически не требует хранения данных для будущих целей и позволяет выполнять аналитическую обработку в реальном времени для получения результатов на основе запросов.

Анализ

В этом разделе мы обсудим, как эти различные типы данных анализируются на основе универсального вопроса, который начинается со слов «что, если...?». Эволюция организаций вместе с данными также повлияла на новые стандарты метаданных, организующие их с целью первичного обнаружения и переработки для структурных подходов, вызревающих на основе ценности создаваемых данных.

Большинство зрелых организаций надежно обеспечивают доступность, превосходство и ценность для бизнес-подразделений с постоянным автоматизированным процессом структурирования метаданных и результатов, которые будут обрабатываться для анализа. В зрелой организации, управляемой данными, механизм анализа обычно работает с несколькими источниками данных и типами данных, которые также включают в себя данные, поступающие в режиме реального времени.

В фазе анализа обрабатываются сырые данные, для которых СУБД MySQL имеет задания MapReduce в Hadoop, которые проводят анализ и выводят результат. Когда данные MySQL расположены в HDFS, к ним в целях дальнейшего анализа может обращаться остальная часть экосистемы инструментов, связанных с платформой больших данных.

Управление

Невозможно извлечь ценность данных для бизнеса без сформулированной политики управления данными на практике. В отсутствии продуманной политики управления данными предприятия могут столкнуться с неправильной интерпретацией информации, что в конечном итоге может привести к непредсказуемому ущербу для бизнеса. С помощью управления большими данными организация может достигнуть последовательной, точной и действенной осведомленности в данных.

Управление данными осуществляется с целью соблюдения законодательных требований, конфиденциальности, нормативно-юридических актов и всего, что является обязательным в соответствии с требованиями бизнеса. В целях управления данными непрерывный мониторинг, изучение, пересмотр и оптимизация качества процесса также должны учитывать потребности в безопасности данных. До сих пор, когда речь шла о больших данных, управление данными принималось с легкостью; однако, с ростом объемов данных и их повсеместным использованием управление данными стало привлекать к себе все больше внимания. Оно постепенно становится обязательным фактором для любого проекта в области больших данных.

Поскольку у нас есть хорошее понимание жизненного цикла больших данных, давайте теперь подробнее рассмотрим основы MySQL, ее преимущества и несколько превосходных функциональных средств этой реляционной СУБД.