Дублированный контент можно разделить на три большие категории: точный дубликат, где два URL-адреса имеют полностью идентичный контент, контент с небольшими отличиями (порядок предложений, немного другие изображения и т. д.) и кроссдоменные дубликаты, где точная или немного измененная копия существует на многих доменах.

Дублированный контент можно разделить на три большие категории: точный дубликат, где два URL-адреса имеют полностью идентичный контент, контент с небольшими отличиями (порядок предложений, немного другие изображения и т. д.) и кроссдоменные дубликаты, где точная или немного измененная копия существует на многих доменах.

Существуют две связанных концепции, которые не считаются Google тем же самым, что и дублированпый контент, но которые часто сбивают с толку издателей и неопытных SEO-специалистов:

- тонкий контент — как было отмечено ранее, это страницы, на которых очень мало контента. В качестве примера можно привести набор страниц, построенный на списке адресов организаций, в котором есть 5000 адресов, но каждая страница содержит только один адрес — всего несколько строк;

- нарезка контента— в эту категорию попадают страницы, которые незначительно отличаются друг от друга. Представьте себе сайт, продающий обувь Nike Air Мах, которая приходит в размерах 37, 37,5, 38, 38,5, 39, ... 46. Если у сайта есть отдельная страница для каждого размера обуви, то разница между всеми этими страницами будет незначительной. Подобный эффект Google и называет тонкой нарезкой.

Google не любит ни тонкий контент, ни тонкую нарезку. Любой из этих эффектов может быть выявлен алгоритмом «Панда». Как именно Bing отличает дубликацию контента, тонкий контент и нарезку контента не ясно, но точно известно, что издатели должны избегать создания этих типов страниц.

Дублированный контент может получиться по многим причинам, в том числе благодаря лицензированию контента вашего сайта, дефектам архитектуры сайта вследствие не оптимизированной под поисковики системы управления контентом или из-за наличия плагиата. В последние пять лет спамеры, испытывающие чрезвычайную необходимость в контенте, начали «выцарапывать» контент из легальных источников, переставлять слова посредством множества сложных процессов и размещать полученный текст на своих страницах, чтобы привлечь операции поиска из «длинного хвоста» и продемонстрировать контекстную рекламу, а также и для прочих бесчестных целей.

Таким образом, сегодня мы живем в мире «проблем дублированного контента» и «штрафов за дублирование контента». Приведем некоторые определения, которые будут полезны для нашего обсуждения.

- Уникальный контент— написан человеком, полностью отличается от любой другой комбинации букв, символов и слов во Всемирной паутине, не подвергался воздействию компьютерных алгоритмов обработки текста (таких как инструменты спамеров, использующие цепи Маркова).

- Фрагменты — это небольшие куски контента (например, цитаты), которые копируются и используются многократно. Они почти никогда не являются проблемой для поисковых движков, особенно когда включаются в более крупный документ с большим количеством уникального контента.

- Шинглы — поисковые движки ищут относительно небольшие сегменты фраз (пять- шесть слов) на других страницах во Всемирной паутине. Если два документа имеют слишком много общих шинглов, то поисковые движки могут интерпретировать эти документы как дублированный контент.

- Проблемы дублированного контента — эта фраза, как правило, служит для обозначения дублированного содержания, за которое сайт может быть оштрафован. Такой контент просто является копией существующей страницы, заставляющей поисковик выбирать, какую версию в индексе нужно отображать (это так называемый фильтр дублированного контента).

- Фильтр дублированного контента — ситуация, когда поисковик удаляет подобный контент из результатов поиска, чтобы предоставить лучшие результаты пользователю.

- Штраф за дублированный контент — штрафы (пенальти) применяются редко и только в очевидных ситуациях. Поисковые движки могут уменьшить рейтинг или запретить остальные страницы сайта, могут даже запретить весь веб-сайт.

Последствия дублированного контента

Предполагая, что ваш дублированный контент является результатом безобидного недосмотра со стороны ваших разработчиков, поисковый движок, скорее всего, отфильтрует все дублированные страницы (кроме одной), поскольку он хочет показать на страницах результатов поиска только одну версию такого контента. В некоторых случаях поисковый движок может отфильтровать результаты до включения их в индекс, а в других случаях — допустить страницу в индекс и отфильтровать ее уже при подготовке результатов поиска в ответ на конкретный запрос. В этом последнем случае страница может быть отфильтрована в ответ на некоторые определенные запросы и не отфильтрована для других.

Пользователи хотят видеть в результатах разнообразие (а не одни и те же результаты снова и снова). Поэтому поисковые движки стараются отфильтровывать дублированный контент, и это имеет такие последствия:

- робот поискового движка приходит на сайт с определенной сметой просмотра, выражающейся в количестве страниц, которые он планирует просмотреть в каждом конкретном сеансе. Каждый раз, когда он попадает на дублированную страницу, которая просто должна быть отфильтрована из результатов поиска, вы позволяете роботу потратить впустую некоторую часть его сметы на просмотр. Это означает, что будет просмотрено меньше ваших «хороших» страниц и приведет к тому, что в индекс поискового движка будет включено меньшее количество ваших страниц;

- несмотря на то, что поисковые движки стараются отфильтровать дублированный контент, ссылки на страницы дублированного контента все равно передают им «сок ссылок». Поэтому дублированные страницы могут получить рейтинг PageRank или «сок ссылок», а поскольку это не помогает им в рейтинге, то этот ресурс теряется впустую;

- ни один из поисковых движков не дал четкого объяснения, как его алгоритм выбирает ту версию страницы, которую будет показывать. Иначе говоря, если он обнаруживает три копии одного и того же контента, то какие две из них он отфильтрует? Какую покажет? Зависит ли это от поискового запроса? В итоге поисковый движок может показать не ту версию, которая вам нужна.

Несмотря на то, что отдельные специалисты по оптимизации могут поспорить с некоторыми из приведенных здесь положений, общая структура практически ни у кого не вызывает возражений. Однако по границам этой модели имеется несколько проблем.

Например, на вашем сайте есть группа товарных страниц, а также версии этих страниц для распечатывания. Поисковый движок может выбрать для показа в своих результатах именно версию для печати. Такое иногда случается, причем это может произойти даже тогда, когда страница для распечатывания имеет меньше «сока ссылок» и более низкий рейтинг, чем основная страница товара.

Для исправления такого положения надо применить атрибут ссылки rel=”canonical” ко всем дублированным версиям страницы, чтобы указать главную версию.

Второй вариант может появиться тогда, когда вы синдицируете свой контент (разрешаете перепечатку своего контента) сторонним организациям. Проблема состоит в том, что поисковый движок может выкинуть из результатов поиска ваш оригинал и предпочесть ему ту версию, которую использует человек, перепечатавший вашу статью. Есть три потенциальных решения этой проблемы:

- пусть человек, переопубликовавший вашу статью, установит обратную ссылку на исходную статью на вашем сайте с атрибутом

rel=”canonical”. Это укажет поисковым машинам, что ваша копия страницы является оригиналом и любые ссылки, указывающие на синдицированную страницу, будут зачислены на вашу оригинальную страницу; - пусть ваш партнер по синдикации закроет свою копию атрибутом

noindex. В этом случае дублированный контент просто не будет индексироваться поисковой машиной. Кроме того, любые ссылки в этом контенте на ваш сайт будут по-прежнему передавать полномочия вам; - пусть ваш партнер сделает обратную ссылку на исходную страницу на вашем сайте. Поисковики обычно это корректно интерпретируют и подчеркивают вашу версию контента. Однако следует отметить, что были случаи, когда Google ошибочно определяла авторство контента и назначала авторство сайту, который переопубликовал его, особенно если тот сайт имеет гораздо больше полномочий и доверия, чем истинный первоисточник контента.

Как поисковые движки распознают дублированный контент?

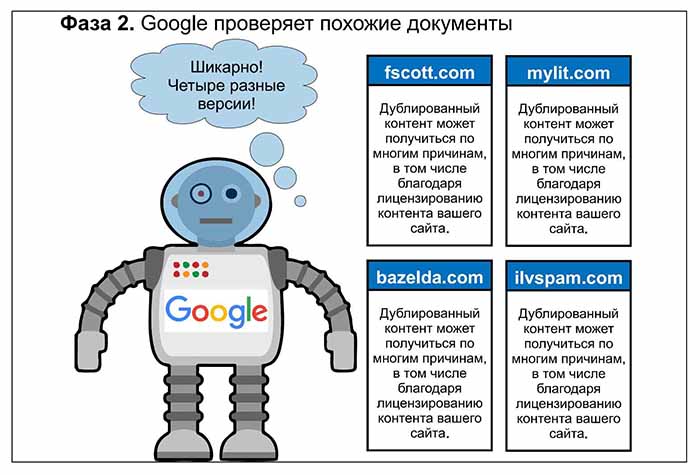

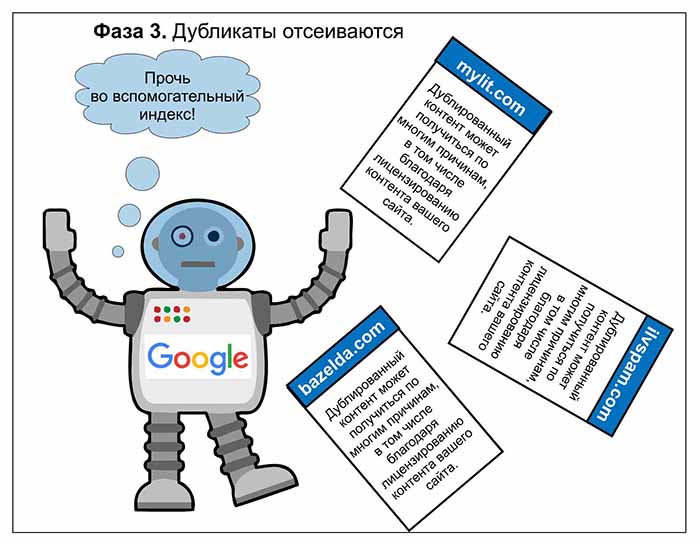

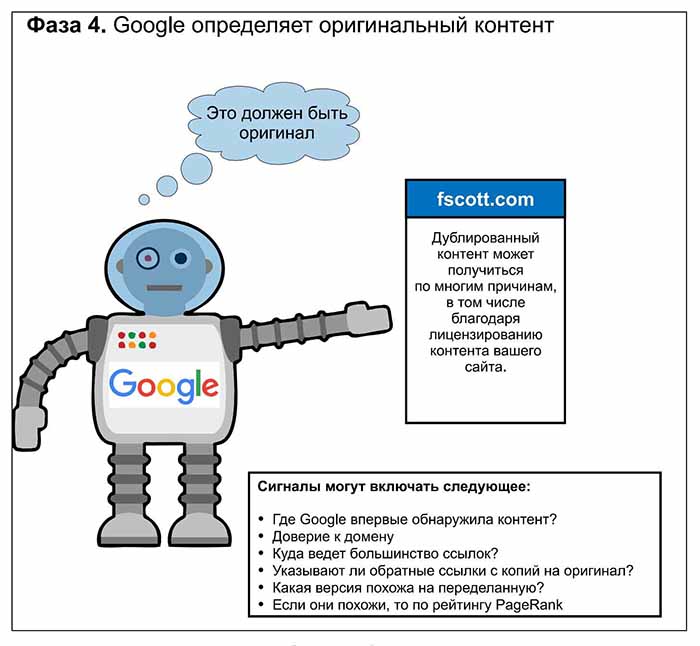

Процесс поиска дублированного контента во Всемирной паутине для движка Google мы проиллюстрируем примерами. В примерах, представленных на рис. 1-4, сделаны три допущения:

- страница с текстом — это страница, содержащая дублированный контент (а не просто его фрагмент, как это показано на рисунках);

- все страницы с дублированным контентом находятся в разных доменах;

- показанные далее шаги были упрощены, чтобы сделать процесс легким и понятным (насколько это возможно). Это, безусловно, не является точным описанием работы Google, но передает смысл.

Рис. 1. Google обнаружила дублированный контент

Рис. 2. Google сравнивает все копии дублированного контента

Рис. 3. Дублированные копии выбрасываются

Рис. 4. Google выбирает оригинал

Имеется несколько фактов, касающихся дублированного контента, которые заслуживают особого упоминания, поскольку они могут запутать веб-мастера, являющегося новичком в области проблем дублированного контента. Рассмотрим эти факторы.

- Местоположение дублированного контента — если весь этот контент находится на моем сайте, является ли он дублированным? Да, потому что дублированный контент может получиться как в пределах одного сайта, так и на разных сайтах.

- Процент дублированного контента — какой процент страницы должен быть дублирован, чтобы попасть под фильтрацию дублированного контента? К сожалению, поисковые движки никогда не раскрывают эту информацию, поскольку это нанесло бы ущерб их способности предотвращать саму проблему.

- Почти уверенно можно утверждать, что этот процент у всех движков постоянно меняется, и при выявлении дублированного контента производится не только прямое сравнение. Итог таков: чтобы считаться дубликатами, страницы не обязательно должны быть идентичными.

- Соотношение кода и текста — а что, если наш код очень большой, но на странице мало уникальных HTML-элементов? Не подумает ли Google, что все страницы являются дубликатами друг друга? Нет. Поисковым движкам нет никакого дела до вашего кода, их интересует контент ваших страниц. Размер кода превращается в проблему только тогда, когда он становится чрезмерным.

- Соотношение навигационных элементов и уникального контента — все страницы моего сайта имеют большую навигационную полосу, много верхних и нижних колонтитулов, но совсем мало контента. Не сочтет ли Google все эти страницы дублированными? Нет. Google (а также Yahoo! и Bing) учитывает элементы навигации еще до оценки страниц на дублирование. Они хорошо знакомы с компоновкой веб-сайтов и понимают, что наличие постоянных структур на всех страницах (или большом их количестве) — это совершенно нормально. Они обращают внимание на уникальные части страниц и почти совершенно игнорируют остальные.

- Лицензированный контент — что делать, если я хочу избежать проблем с дублированием контента, но у меня есть контент из других веб-источников, который я лицензировал для показа своим посетителям? Используйте код

meta name = "robots” content="noindex, follow". Поместите его в верхнем колонтитуле вашей страницы, и поисковые движки будут знать, что этот контент не для них. Это лучшая практика, поскольку люди все равно смогут посетить эту страницу и сделать на нее ссылку, а ссылки на этой странице будут сохранять свою ценность.

Другой вариант— получить эксклюзивные права на владение этим контентом и его публикацию.

Выявление и устранение нарушений авторских прав

Один из лучших способов отслеживания дублирования вашего сайта — это прибегнуть к помощи сайта CopyScape (copyscape.com), который позволяет моментально увидеть те страницы во Всемирной паутине, которые используют ваш контент. Не беспокойтесь, если страницы этих сайтов находятся во вспомогательном индексе или имеют значительно более низкий рейтинг, чем ваши, — если бы какой-то большой, авторитетный и богатый контентом домен попытался бороться со всеми копиями его материалов во Всемирной паутине, то ему потребовались бы, по крайней мере, два человека на полную рабочую неделю. К счастью, поисковые движки доверяют таким сайтам и поэтому признают их оригинальными источниками.

С другой стороны, если у вас есть относительно новый сайт или сайт с небольшим количеством входящих ссылок, а плагиаторы постоянно стоят в рейтинге выше вас (или вашу работу крадет какой-то мощный сайт), то вы можете кое-что предпринять. Один из вариантов— отправить запрос издателю с просьбой удалить контент, нарушающий авторские права. В некоторых случаях издатель просто не знал о нарушении авторских прав. Еще один из вариантов — написать хостинг-провайдеру. Хостинговые компании потенциально могут нести ответственность за организацию дублированного контента, поэтому они часто быстро реагируют на такие запросы. Просто убедитесь, что вы готовы предоставить как можно больше возможной документации, подтверждающей авторство контента.

Следующий вариант — отправить запрос о нарушении авторских прав (DMCA) в Google, Yahoo! и Bing. Этот же запрос вам следует отправить и той компании, у которой размещен сайт нарушителя.

Второй вариант — возбудить дело в суде против сайта-нарушителя или пригрозить это сделать. Если публикующий ваши работы сайт имеет владельца в вашей стране, то этот вариант, вероятно, является самым разумным первым шагом. Вы можете начать с более неформального общения и попросить удалить контент еще до того, как посылать официальное письмо от адвоката, поскольку до вступления в силу мер агентства DMCA могут пройти месяцы. Но если вам не отвечают, то у вас нет никаких причин откладывать более серьезные действия.

Очень эффективным и недорогим вариантом для этого процесса является ресурс DCMA.com.

Ситуация с реальным штрафом

Предыдущие примеры показывают работу фильтров дублированного контента, но это не штрафы, хотя в практическом смысле эффект тот же самый, что и от штрафов, — снижение рейтингов ваших страниц. Однако есть и такие ситуации, когда может появиться настоящий штраф. Например, этим рискуют агрегирующие контент сайты, в особенности если сам сайт добавляет мало уникального контента. При таком сценарии сайт может быть реально оштрафован.

Исправить это можно только уменьшением количества дублированных страниц, доступных пауку поискового движка. Это достигается путем их удаления, посредством добавления атрибута canonical в дубликаты, атрибута noindex в сами страницы, либо добавлением значительного количества уникального контента.

Пример контента, который может часто отфильтровываться, — это «тонкий» сайт-партнер. Так часто называют сайт, который продвигает продажи чужих товаров, чтобы заработать комиссионные, но не предоставляет новой информации. Такой сайт мог получить описания от изготовителя товаров и просто воспроизвести эти описания вместе со ссылкой на партнера, чтобы заработать на «кликах» или покупках.

Проблема возникает тогда, когда продавец имеет тысячи партнеров, использующих один и тот же контент, — а инженеры поисковых движков получили от пользователей данные о том, что (с их точки зрения) такие сайты не добавляют ничего ценного в их индексы. Поэтому поисковые движки пытаются отфильтровать такие сайты или даже исключить их из своих индексов. Партнерские модели применяет множество сайтов, но они также предоставляют и новый богатый контент, поэтому у них обычно нет проблем. Поисковые движки принимают меры только тогда, когда одновременно возникает и дублирование контента, и отсутствие уникального ценного материала.

Как избежать дублированного контента на сайте?

Как мы уже отмечали ранее, дублированный контент может создаваться многими способами. Внутреннее дублирование материала требует применения специфической тактики, чтобы получить наилучшие с точки зрения оптимизации результаты. Во многих случаях дублированные страницы — это такие страницы, которые не имеют ценности ни для пользователей, ни для поисковых движков. Если это именно так, попытайтесь полностью устранить эту проблему. Подправьте реализацию таким образом, чтобы на каждую страницу ссылался только один URL-адрес. Сделайте также 301-й редирект для старых URL-адресов на оставшиеся URL-адреса, чтобы помочь поисковым движкам как можно быстрее увидеть произведенные вами перемены и сохранить тот «сок ссылок», который имели удаленные страницы.

Если сделать это невозможно, то имеется еще много других вариантов. Далее представлена сводка указаний по самым простым решениям для самых разных сценариев:

- используйте файл

robots.txtдля блокирования пауков поисковых движков, чтобы они не ползали по дублированным версиям страниц вашего сайта; - используйте элемент

rel="canonical"— это второе решение (из лучших) для ликвидации дублированных страниц; - используйте КОД

<meta name="robots" content="noindex">, чтобы дать указание ПОИСКОВЫМ движкам не индексировать дублированные страницы.

Однако учтите: если вы используете файл robots.txt для предотвращения просмотра страницы, то применение атрибута noindex или nofollow на самой странице смысла не имеет. Поскольку паук не может прочитать эту страницу, то он никогда не увидит атрибуты noindex или nofollow. Помня об этих инструментах, рассмотрим некоторые специфичные ситуации дублированного контента.

HTTPS-страницы — если вы используете протокол SSL (шифрованный обмен между браузером и веб-сервером, который часто применяется для электронной коммерции), то на вашем сайте есть страницы, начинающиеся с

HTTPS:(вместоHTTP:). Проблема возникает тогда, когда ссылки на ваших HTTPS-страницах указывают на другие страницы сайта с использованием относительных, а не абсолютных ссылок (так что, например, ссылка на вашу домашнюю страницу становитсяhttps://www.ВашДомен.comвместоhttp://www.ВашДомен.com).Если на вашем сайте имеется такая проблема, то для ее решения вы можете использовать элемент

rel="canonical"или З01-е редиректы. Альтернативное решение— изменить ссылки на абсолютные:http://www.ВашДомен.com/content.htmlвместо/contenthtml), что заодно несколько усложнит жизнь тем, кто ворует ваш контент.- Системы управления контентом, создающие дублированный контент — иногда на сайте есть много версий идентичных страниц. Такое бывает из-за ограничений в некоторых системах управления контентом, которые адресуют один и тот же контент с более чем одним URL-адресом. Обычно это совершенно ненужное дублирование, которое не имеет ценности для пользователей, и лучшее решение— удалить дублированные страницы и сделать 301-й редирект для удаленных страниц на оставшиеся страницы. Если не получится, попробуйте другие способы (приведенные в начале этой статьи).

- Страницы для печати или множество вариантов сортировки — многие сайты предлагают страницы для печати, которые предоставляют пользователю тот же самый контент в адаптированном для принтера формате. Некоторые сайты электронной коммерции предлагают списки своих товаров с множеством возможных сортировок (по размеру, цвету, бренду и цене). Эти страницы имеют ценность для пользователя, но не имеют ценности для поисковых движков, и поэтому будут казаться им дублированным контентом. В такой ситуации необходимо либо использовать один из ранее приведенных в этом блоге вариантов, либо настроить таблицу CSS для печати (как это описано в посте yoast.com/added-print-css-style-sheet/ на сайте Yoast).

- Дублированный контент в блогах и системах архивирования— блоги представляют собой интересный вариант проблемы дублированного контента. Пост в блоге может появиться на нескольких разных страницах: на начальной странице блога, на странице пермалинков этого поста, на страницах архива и на страницах категорий. Каждый экземпляр поста представляет собой дубликат остальных экземпляров. Очень редко издатели пытаются справиться с проблемой присутствия поста как на домашней странице блога, так и на странице пермалинков. И, по-видимому, поисковые движки достаточно хорошо справляются с этой проблемой. Однако, возможно, есть смысл показывать на страницах категорий и архива только фрагменты постов.

- Генерируемый пользователями дублированный контент (повторные посты и т. д.) — многие сайты реализуют структуры для получения генерируемого пользователями контента, такие как блоги, форумы или доски объявлений. Это могут быть отличные способы разработки большого количества контента с очень низкой стоимостью. Проблема состоит в том, что пользователь может одновременно опубликовать один и тот же контент и на вашем сайте, и на нескольких других сайтах, что и приводит к появлению дублированного контента. Контролировать это сложно, но для уменьшения проблемы можно учесть следующее:

- нужно иметь четкую политику, которая уведомляет пользователей о том, что поставляемый ими на ваш сайт контент должен быть уникальным и не может быть размещен на других сайтах. Конечно, добиться этого трудно, но это поможет понять ваши ожидания;

- реализуйте ваш форум таким уникальным образом, который потребует иного контента. Дополнительно к стандартным полям для ввода данных добавьте также некие уникальные поля (отличающиеся от других сайтов), которые будет полезно видеть посетителям вашего сайта.